Kode med SI-enheter: en smakebit

Jeg (Teodor) skal presentere på online-konferanse denne uka: fredag 17. oktober, 2025. Det er pengemessig gratis, og koster deg kun halvtimen jeg skal bruke til å snakke.

Dagens OLORM er en utfordring: Kan budskapet i presentasjonen min tilpasses til Javascript, og kjernen formidles for Javascript-kyndig leser på fem minutter? Jeg prøver.

Du har kanskje skrevet kode som denne:

const iterationTimeMs = 300;

const iterations = 53;

const totalTimeSeconds = iterationTimeMs * iterations / 1000;Det er vel ikke så ille?

Jo! Jeg ser en ting som “distraherer” koden. En kode-leopard, om du vil.

Fordi *-operatoren ikke kan forskjellen på millisekunder og sekunder, må vi regne ut enheten i hodet! Den mentalgymnastikken øker kognitiv last for oss utviklere. Mentalgynastikken øker også sannsynligheten for feil, vi må huske på å bruke de magiske tallene (her 1000) rett for å få rett enhet.

Den samme kodesnutten kunne sett sånn ut:

import * as munit from "munit";

import * as si from "munit/si";

const iterationTime = munit.mult(300, si.milli, si.second);

const iterations = 53;

const totalTime = munit.mult(iterationTime, iterations);Bedre?

Som alltid, å trekke inn biblioteker øker “tyngden” på programmet

ditt. Og én enklelt konvertering fra millisekunder til sekunder er

kanskje greit? Jeg skrev forresten en bug i koden øverst i første

versjon: iterationTimeMs * iterations * 1000;. Resultatet

ble én million ganger for stort!

Strukturert modellering av tall med enhet (SI eller andre ting, feks valuta) gir mer verdi jo vanskeligere problemet ditt her. Prøv deg på kilonewton per meter, sammen med lengder i millimeter, og momenter i kilonewtonmeter! Først med mentalgymnastikk, vanlige javascript-tall og enhetskonvertering i hodet. Så med operasjoner som forstår tall med SI-enhet.

Det var hele smakebiten. Kom på Macroexpand 2025 for å se resten!

Les mer eller meld deg på konferansen (penge-gratis, online) på scicloj.github.io/macroexpand-2025/

Eventuelt hjelp meg å nå på verdensveven ved å lage ståhei på Linkedin.

Ha en fortsatt god mandag!

Hilsen Teodor

Dyp intensjon og aktiv leveranse: to moduser for produktbygging

Etter en ellers helt super jobbkos-kveld med Julian, satt jeg igjen med en følelse av at det var noe som ikke helt stemte.

Mønsteret gikk som følger:

- Vi startet å gjøre noe

- Julian fikk en idé

- Vi snakket litt

- Jeg sa at vi måtte la ideen ligge for å bli ferdig med det vi startet på.

Det som skurret for meg var at jeg ikke hadde noen grunn til at vi måtte la det ligge. Etter en uke i underbevisstheten er svaret klarere for meg: vi var ikke tydelige på om vi var i dyp intensjonsmodus eller aktiv leveransemodus.

Når jeg jobber med egne fritidsprosjekter og får gjort noe, faller jeg inn på følgende prinsipper:

Jeg er uinteressert i å gjøre noe hvis det ikke er en motiverende grunn til å gjøre noe. Dårlig intensjon gir dårlig motivasjon, og da kan du la være, resultatet blir dårlig og arbeidet blir kjipt.

Hvis jeg skal få gjort noe, må veien ut i virkeligheten være kort. Jeg må få det ut. Det må bli ekte.

For å oppnå det, bytter jeg mellom to moduser: dyp intensjon og aktiv leveranse. I dyp intensjonsmodus følger jeg “hvorfor” spørsmålene helt ned, og gir meg ikke før jeg har drømt opp noe jeg ønsker at skal finnes i verden. I aktiv leveransemodus skal jeg få ned ekte arbeid, og levere én eller flere ganger i løpet av økta jeg setter meg ned. Jobber jeg med kode betyr det at jeg skal ha ekte kode som gjør noe interessant i løpet av samme dag.

Kvelden med Julian satte vi oss mål som var supre for å sikre aktiv leveranse:

- Julian skal ha sitt eget, personlige nettsted innen kvelden er omme

- Julian skal være i stand til å endre nettstedet sitt uten hjelp

- Nettstedet skal ta ett, konkret steg i retning av at Julian kan bruke nettstedet til å kommunisere noe han bryr seg om.

For å sikre at vi fikk til det, kuttet jeg oss av!

Men biten jeg ikke likte var at det var en greie jeg gjorde, ikke noe som vi gjorde sammen. For å sikre at vi gjør det sammen neste gang, noterer jeg meg følgende:

- Bruk dyp intensjon for å sikre at du lager noe du ønsker å lage

- Bruk aktiv leveranse for å sikre at du faktisk lager noe

- I samhandling, ikke bruk tvang for å bytte modus, velg byttene sammen.

Takk til Christian som har gitt meg praktisk trening for når man bør bytte til aktiv leveransemodus.

Teodor

Ta kreativiteten din seriøst!

Hva gjør du når inspirasjonen slår ned? Skriver du en idé bak øret, eller kapitaliserer du, og får noe ut i virkeligheten?

Hvis du blir vant til å ta ideene dine ut, kommer kreativiteten din til å endre seg: du kommer til å lære deg hvordan du endrer virkeligheten.

Noen ganger lurer jeg på hva som skjer hvis jeg ikke prøver å kapre en idé. Kan det være en bra ting? Tør stort sett ikke å prøve.

Kreativiteten i deg er to personer: skaperen og kritikeren. Du må trene begge! Skaperen kommer med forslag, kritikeren feier dem ned, én etter én. Men noen kommer gjennom. Og noen ganger må du lage noe som er dårlig nok til at du faktisk får det ut.

— Julian og Teodor

Mikro OG makro

Julian har satt fingeren så hardt på at man bør på med både mikro- og makroperspektivet at jeg ikke klarte la være å skrive litt. På Høstutstillingen i år finner dere en samling fugler:

Makro: 16 fugler!

… men … hva er dette? Et menneske, opp-ned?

I alle dager, enda et menneske på hodet til fuglen.

Og et menneske inni mennesket!

Jeg synes denne zoome-effekten er superspennende. Vi har detaljert, “ru” tekstur både på makro og på mikro. Som Julian så fint sa om Google Earth,

du kan zoome, og hvert nivå på skalaen er spennende.

Foto: undertegnede.

Teodor

Hypermedia forklart i to begreper

Hypermedia er en hjerne-basill som har grepet teknologer siden 1945 (Vannervar Bush), blitt beriket på 60-tallet (Ted Nelson), delvis kommet seg ut på Internett (Tim Berners Lee), men ikke helt (Roy Fielding, 2000-2009).

Den korte definisjonen av et hypermedia-system er:

- Serveren sender klienten tilgjengelige hypermedia-kontroller. En hypermedia-kontroll styrer hva du kan gjøre, som å navigere til en side eller flytte på en markør på et kart.

- Klienten beriker brukergrensesnittet med kunnskap om media-typer. Du kan starte med å støtte mediatypen tekst på klienten. Deretter kan du for eksempel berike klienten til å støtte markdown eller innsatt bilde.

Disse prinsippene er alt du trenger for å lage hypermedia-systemer!

Men hva har det å si i praksis? Når vi skriver webapplikasjoner der klienten vet mye om hva som foregår, får vi problemet med å synkronisere denne kunnskapen mellom serveren og klienten. Å bygge systemet på hypermedia løser dette:

- serveren vet alt

- klienten vet kun:

- hvor den er (feks med en URI),

- hva den kan gjøre (feks med lenker og skjemaer, kjent som hypermedia-kontroller),

- og hva ting er (mediatype).

Hvis dette vekker interessen din, anbefaler jeg på det varmeste Hypermedia: The First 2000 Years med Asbjørn Ulsberg, fra Javazone 2025.

Prat med Asbjørn etter fordraget gjorde at jeg til slutt skjønte hvorfor klienten måtte støtte mediatyper. Tusen takk, Asbjørn!

—Teodor, september 2025

Jeg gjentar, begrens uferdig arbeid!

Dette er uferdig arbeid:

Du kjenner uferdig arbeid selv. Du våkner opp til et kjøkken fullt av gårsdagens oppvask. Du har ikke plass til pc-en fordi pulten er full av bunker med papir.

Å rydde opp etter seg er mye lettere når du gjør jobben. Når du kommer tilbake, må du i tillegg gjøre MER ARBEID for å finne ut hva det var du egentlig hadde tenkt.

Begrens uferdig arbeid.

Stoler du på deg selv?

Interaksjoner med andre folk bygger tillit eller bryter tillit. En venn viser en ferdighet vi ikke ante om. En kollega følger opp med oss og har løst nøyaktig det problemet vi snakket om. En fremmed strekker ut en hånd uten at vi har gjort noe for å fortjene det.

Tillit bygges gjennom mange positive Interaksjoner over lang tid. Men tillit kan brytes med én handling. Denne teksten handler ikke om hvordan man bryter tillit.

Hvordan skal du bygge tillit til det selv? “fake it till you make it”? Det har jeg lite tro på, det føles hult og uærlig. Ta heller deg selv like seriøst som du tar folk du stoler på. Strekk deg etter en ny ferdighet. Hold noe du har lovet deg selv.

Ikke se på selvtillit som arroganse eller overmot. Se heller på deg selv som en person du ønsker å bygge en tillitarelasjon med.

Takk til Rune Larsen for spørsmålet “hva om du gjør det som bygger tillit?” ved kaffemaskina rundt årsskiftet 2019-2020.

Min gamle mobiltelefon

Mobiltelefonen min begynner å dra på åra. Jeg tror jeg kjøpte den tidlig 2019, så nå har den vel bikka 6 år gammel. Hurra! Joda, den henger litt bak en del yngre modeller. Batteriet er ikke helt konge og høytaleren er litt spengt, men den funker. Det jeg derimot merker aller best er at den ikke har de samme prosseseringsmusklene som nyere mobiltelefoner, eller datamaskina jeg jobber på fra dag til dag.

Og det gir meg innsikt.

Jeg får rasende fort tilbakemelding dersom en nettside krever mye ressurser. Eksempelvis er reddit.com ganske krise å surfe på min gamle mobiltelefon. Det samme opplever jeg til tider på nettsidene jeg selv er med å utvikler. De kjører rett og slett ikke slik jeg er vant med fra den raske jobbdatamaskina mi. Og motsatt finnes det andre sider hvor jeg merker veldig tydelig at det kjører raskt og bra.

Alt dette er det fint å være klar over. Jeg tror nemlig ikke jeg er den eneste brukeren med en gammel mobiltelefon.

Den omfangsorienterte designeren

Jeg digger å jobbe med designere som aktivt tar stilling til omfanget av jobben som skal gjøres. Les hvorfor.

Kontinuerlig leveranse

Designskissen skinner så du ser refleksjonen i den. Alt er perfekt. Fargene, forholdene. Teksten ser ut som en dessert fra en michelinstjernerestaurant. Du har et problem.

Hvor i all verden skal du starte?

Ifølge DORA (dora.dev/capabilities/continuous-delivery) leverer produktteam som praktiserer kontinuerlig leveranse jevnt over bedre produkter. Når man skal levere kontinuerlig må én bit leveres om gangen; og bitene som leveres informerer videre utvikling.

Men hvor i all verden skal du starte?

Den pixel-perfekte prototypen

Å finne det gode stedet å starte er en designjobb. Men det designet treffer ikke sluttbrukeren: det designet treffer utvikleren og designeren. En piksel-perfekt prototype peker ikke på hvor det er best å starte. Den gjør det motsatte: den sidestiller alle tingene som kan gjøres.

I stedet, finn ut hva første versjon av produktet skal gjøre. Hvem skal oppnå hva?

Hvis du ikke stiller det spørsmålet og svarer på det med en hypotese, har du ikke et tydelig mål. Da smetter “det skal se ut som på skissen” inn som mål i stedet. Da får du:

- Ukjent/uklar produktverdi

- Ukjent/uklar ferdigstillingsdefinisjon

- Masse work in progress.

Jeg mener vi bør unngå å ta opp work in progress når vi kan, se for eksempel OLORM-50: For mye opsjonalitet. Når målet med arbeidet i tillegg er udefinert, har vi lagd flere problemer for oss selv enn vi har løst.

Den omfangsorienterte designeren

Nivå 1 av jobben til den omfangsorienterte designeren er å ta “vi skal definere et smalt neste steg” seriøst. Ikke gjør mer enn nødvendig på én gang. Tenk “hvordan skal det tas i bruk” fra steg 1. Da lager vi så lite work in progress vi får til; vi setter oss i posisjon hvor vi kan fullføre.

Nivå 2 av jobben til den omfangsorienterte designeren er å kode det opp direkte i HTML og CSS. Lag noen HTML-filer og CSS-filer i kodebasen. Det blir da ettertrykkelig tydelig hvordan man kan blåse liv i prototypen med ekte data og ekte interaksjoner.

Med noen runder HTML og CSS i koden kommer utvikleren fort til å klø seg i hodet eller skjegget (eller andre steder med kroppshår) og tenke “hvorfor kan ikke designeren bare endre produktet direkte?” Det er et veldig godt spørsmål! Og svaret er ja. Det går. Men da må du rigge kodebasen så designeren faktisk får gjort jobben sin når desineren setter seg ned for å jobbe. Det betyr at designeren får fokusert på det visuelle utrykket, uten å bli distrahert av detaljer som ikke har med visuelt inntrykk å gjøre.

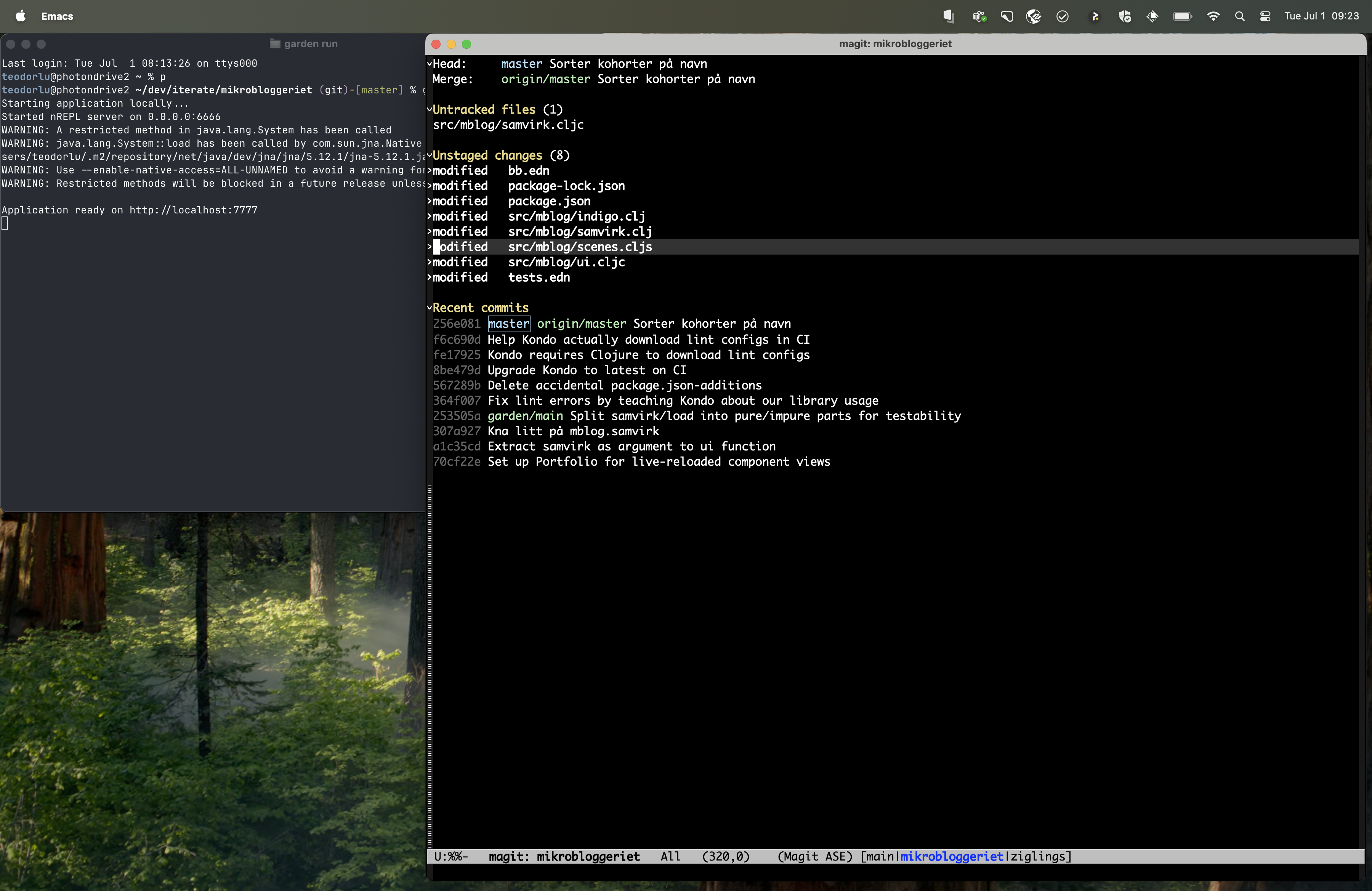

Visuelt arbeid på Mikrobloggeriet: ujålete CSS-filer, punktum.

Redesignet Mikrobloggeriet fikk vinteren 2025 er skrevet rett i CSS av Neno, som er utdannet designer. Neno kjører kodebasen lokalt, endrer CSS-filer og pusher og prodsetter med Git. Vi har gjort “push og prodsett” til én kommando. Hvis den var et bash-script, ville den sett cirka sånn ut:

set -e # ellers stopper ikke Bash når noe tryner, lol

./test.sh

./lint.sh

./try-deploy.sh # deploy feiler hvis appen ikke klarer å starte opp

git push“men er ikke gå rett i prod skummelt, da?” I praksis, nei. Det er tryggere. Det er lettere å forbedre systemet, inkludert å legge på nødvendig sikkerhetsnett.

Den omfangsorienterte designeren lar produktteamet levere raskere og bedre

Design-utvikler-interaksjonen i Mikrobloggeriet-arbeid er såpass bra at jeg vil jobbe hardt for å beholde den flyten. Som utvikler får jeg fokusert på domeneproblemer og tilgjengeliggjøring av data, og slipper “implementer denne plx”-gjørejobber. Det gjør at vi klarer å shippe redesign på rekordtid på et hobbyprosjekt vi gjør ved siden av vanlig jobb.

Hvis du er designer eller utvikler, anbefaler jeg å prøve det. Gøy og bra :)

Takk til Neno Mindjek og Eirik Backer for gode diskusjoner om samspillet mellom utviklere og designere, og til Christian Johansen og Magnar Sveen for gode tanker om hvordan framside-kode kan struktureres på enkelt vis.

Leik gir liv gir samhold gir kvalitet

Lag noe sammen! Finn glede i å skape! Med en gruppe får du liv og samhold. Det vi lager sammen er vårt, og blir større enn individene.

At du ikke trenger å bestemme alt selv er bra av to grunner:

Du kommer lengre med flere. Når du tar alle valg, kommer du til å gå tom for damp. Med flere kan man ta tak i problemene sammen, og dra litt hver av oss.

Det du lager blir bedre. I “hva er bra?”-spørsmålet kan du få med flere stemmer. Folk har forskjellige referanser, og de referansene får du bruk for.

For å komme i gang, lek. Ikke sett kjipe forutsetninger. Ikke lag deg en tvangstrøye du ikke vil gå med.

Så, lek!

… men … hva så? Lek er overraskende nok ikke alltid gøy. Jeg kan i alle fall gå lei. “Nå har jeg tulla nok, nå vil jeg gjøre noe ekte.”.

Da går du videre. Lek blir til liv. Livet skaper over tid samhold. Og det samholdet bygger kvaliteten.

Liv på Mikrobloggeriet

I det siste har Mikrobloggeriet vært livlig! Jeg hadde en dritkul opplevelse på mandag denne uka. Neno nevnte fredagen før,

du teodor

jeg må si noe

det gjelder barnet ditthææææææh. jeg har jo ikke noe barn?

Nei, Neno, det er ditt barn!Lol, ta den. Jeg kan også tulle.

neeei, ikke det barnet

mikrobloggeriet

vi skal GJØRE TING med mikrobloggerietåååååå

så nå er vi her :)

ting er ikke helt som før. På en god måte, vil jeg si.

Mer liv på Mikrobloggeriet

I dag må man lage nye dokumenter med

./mblog.sh COHORT.

Du kan spørre deg selv “… men er det lett for alle, da?”, og svaret er nei!

Så vi prøver oss med en ny kohort.

Den heter LEIK.

Den er hakket mer leken enn de eksisterende kohortene.

Dokumenter på leik har et tall, og skrives i Markdown. De ser da feks sånn ut:

1.md(det er sånn denne ser ut).

Og den ligger i

text/leikpå Mikrobloggeriet.

Det er ikke noen flere steg :) Burde være lett å skrive fra web-editoren uten å kjøre noe kode. Og vanskelig å gjøre feil.

Men med litt leik får vi kanskje mer liv, samhold og kvalitet!

MIKROBLOGGERIET_2.0_WIP

Mai 2025

2025-05-05

Opsjoner: - [ ] Revurdere bilder - [ ] flere inputformater - feks rst og typst - [ ] fikse fotnoter - [ ] delbar enkeltside - [ ] Bedre UX for navigering og filtrering - [ ] tags - [ ] “vanskelig å skrive markdown” for noen

Gammalt

Mars 2025 / Ny forside

16.3.2025: indigo, høyre, venstre

17.3.2025: css, markdown->hiccup, lazy-load, pandoc, ny front og farger

18.3.2025: css + visited state

19.3.2024: lagt til POC-kohort som er lettere å skrive rett fra github, LEIK Ønske til designerene våre: vurdere (et lite hakk) tydeligere overskrifter? Litt vanskelig å skille seksjonene i feks https://mikrobloggeriet.no/#leik-1 fra hverandre.

Work in progress:

OJ-6: Noen tanker boken Ekko - Et essay om algoritmer og begjær

I februar leste jeg boken Ekko - Et essay om algoritmer og begjær av Lena Lindgren. Boka kom ut i 2021, og er nok kjent for flere av dere da den mottok stor ros fra litteraturkritikere, og vant priser som Brageprisen for beste sakprosabok. Jeg hadde fått med meg at boka fantes, men det var ikke før i år at den havnet forran meg.

Boka, eller essayet, ble skrevet som et forsøk på å forstå samtiden, og hvordan Silicon Valley, medieteknologien og utviklingen av sosiale nettverk har bidratt til å påvirke den. Lindgren prøver å tolke fremveksten ekkokammer, hatprat, splitting og radikalisering, avhengighet, synlighet og oppmerksomhet, og effektene som har bidratt til disse fenomenene. Sentralt for fenomenene er oppmerksomhetsøkonomien, og algoritmene som er utformet for å maksimere inntjeningen. Og algoritmene har forstått at disse fenomenene er lønnsomme.

Essayet bruker den romerske myten om Ekko og Narcissus som en rød tråd, eller anologi for å beskrive disse fenomenene. Myten handler om Narcissus, som er forelsket i seg selv og sitt eget speilbilde, og nymfen Ekko, som forelsker seg i Narcissus. Ekko er blitt forbannet etter å ha bablet meningsløshet for å distrahere, og har nå kun mulighet til å gjenta det siste andre har sagt. Myten ender med at Narcissus dør, besatt av sitt eget speilbilde, mens Ekko blir revet i stykker, besatt av Narcissus, og lever videre kun som en stemme som gjentar andre. Det er ikke åpenbart å trekke parallene mellom denne cirka 2000 år gamle fortellingen, og hvordan vi som menneskers oppførsel er i den nye medieteknologien og sosiale nettverk. Jeg synes essayet fletter disse to sammen på en spenennde måte.

Men det var kanskje nok om selve boken. Den er ikke så lett å beskrive i korte trekk. Jeg tenker derfor å skrive kort om hvorfor jeg likte denne boka, og hva jeg fikk ut av den.

Jeg likte denne boken, først og fremst fordi den gav meg noe mer klarhet i en stadig mer forrvirende verden. De siste 10 årene, og kanskje særlig fra valget det amerikanske valget i 2016, hvor Trump for første gang ble stemt inn som president, har endringene skjedd fort. Folks oppførsel og handlinger oppleves mer og mer irrasjonelle, og det er vanskeligere og vanskeligere å forstå hvorfor folk gjør hva de gjør. Jeg opplever at vi lever i stadig mer forskjellige virkligheter. For min del har denne følelsen kun økt siden 2016. Og særlig denne siste måneden hvor Trump igjen har kommet til makten i USA, og verden har blitt veltet på hodet i forrykende tid.

Nettopp denne utviklingen synes jeg Ekko diskuterer på en god måte. Særlig synes jeg Lindgren gjør en god jobb i å belyse mekanismene som gjør at vi mennesker oppfører slik vi gjør, og hvordan algoritmene bidrar til dette. Det hjalp meg med å forstå hvorfor Trump gjør som han gjør nå, hvorfor teknologi-lederene i Silicon Valley stiller seg bak, og hvorfor mennesker gjør statig mer rare og uforståelige ting.

Jeg kommer ikke til å diskutere alt dette i denne mikrobloggen, da det fortsatt er vanskelig å sette alle tankene i ord, og. Jeg oppfordrer derimot til å lese Ekko - Et essay om algoritemer og begjær. Den er kort og bra skrevet, og veldig dagsaktuell. Også ønsker jeg gjerne å diskutere disse temaene videre.

Olav 📣

Unngå forgrening!

Jeg har blitt mye mer var på når jeg innfører forgrening i kode enn før. Men hva i all verden skal det egentlig bety?

Å “innføre en gren” betyr noe mer enn å kjøre

git switch --create, ikke sant?

De første grenene springer ut fra trestammen

Ordet “branch” på norsk betyr “gren”. Trær har grener.

Et tre har én trestamme. Når trestammen først forgrener seg, får vi grener ut fra trestammen.

Trestammen forgrener seg og blir til flere grener. Grener kan også forgrene seg i flere grener.

Hver if lager en

ny gren i koden

Før hadde denne koden én logisk flyt. Nå har den to!

Hver gang koden skal feilsøkes, må vi skjønne begge grenene i koden. Kunne vi latt være å forgrene? Når vi forgrener fra nye grener gjør vi det enda vanskeligere for oss selv.

Jeg liker å forgrene i starten, og deretter la koden flyte så rett som mulig.

Hver

git switch --create lager en ny gren i hodet til

utviklerne

Vi stopper ikke alltid ved skillet mellom lokal kode og produksjon. Git kan holde styr på historikken til koden. Git kan også la oss lage så mange grener vi ønsker. Det er ingen grenser! Jo flere grener vi lager, jo flere grener må vi kjenne forskjellene mellom. Og når vi skal slå sammen to grener (anti-forgrene?), får vi alle forskjellene tilbake i fleisen.

Hvis vi lar være å forgrene, slipper vi å holde styr på alle grenene.

Unminifying av kode med LLM

Akkurat nå jobber jeg med å skrive om noe funksjonalitet i en gammel app. Spesifikt skal jeg bytte ut kartleverandør. I bunn er det Leaflet som brukes til å vise kartene, men Leaflet lå bak en wrapper fra den forrige kartleverandøren. Derfor var det ikke bare å erstatte det gamle kart-endepunktet med det nye. Jeg var derimot avhengig av å vite hva som skjedde bak kulissene, men wrapper-koden var minified. Da er ikke koden særlig lesbar.

For en stund tilbake kom jeg over denne artikkelen på HN, som i bunn og grunn er en bedre versjon av dette blogginnlegget jeg nå sitter og skriver. Poenget er at LLMer er overraskende gode på å unminifye kode, og det kan man bruke dersom man plutselig har behov for å forstå noe minified kode.

Jeg limte koden min inn i Claude, og ut fikk jeg en penere formatert kode, litt mer deskriptive variablenavn, og noen kommentarer. Kommentarene var ikke alltid riktig, men nå manglet jo modellen litt kontekst også. Uansett fikk jeg lesbar kode ut, som jeg kunne bruke til å forstå hva jeg trengte å ta med videre når jeg skulle skrive meg ut av denne wrapperen.

Tidlig verdi, høy kohesjon og lav kobling: tre lekser fra Mikrobloggeriet

Morn :) Teodor her. Å jobbe med Mikrobloggeriet har vært en læringsreise for meg. Fra starten ønsket jeg å lage en arena der vi kan lære sammen og være nysgjerrige; der selve systemet også er formbart og inkluderende. Per 2024-12-21 teller Mikrobloggeriet 1669 commits, og om lag 100 publiserte mikroblogginnlegg (som får meg til å tenke at en statistikkside hadde vært gøy).

Snøen faller i Oslo, og kanskje roen vil senke seg etter hvert. Å roe ned for meg handler ofte om refleksjon og langsiktighet. Når stresset letter litt og antallet ting som skal gjøres hver dag faller, kommer motivasjonen til å se litt tilbake og å se litt fram snikende.

Jeg vil gå gjennom tre ting jeg mener har vært viktig, hvorfor det har vært viktig, og hvorfor det som var viktig ikke var intuitivt i første omgang.

Tidlig verdi

Målet mitt med Mikrobloggeriet var ikke å ha en kodebase jeg kunne pelle på, det var å skrive sammen om ting vi hadde lært. Jeg definerte verdi som “vi som skriver på Mikrobloggeriet skal få noe ut av å skrive sammen”.

Første milepæl var å få en start på innholdet. Her er committen der Lars Barlindhaug skrev OLORM-1:

https://github.com/iterate/mikrobloggeriet/commit/b42b365f00e1ad7630f21cd43186804aee8e392a

Og her er hele innholdet:

# En god natts søvn

I går holdt jeg på en litt kompleks refaktorering hvor jeg skal hente

fargevarianter for en garnpakke fra to forskjellige steder i databasen, avhengig

av om de er opprettet av designeren av oppskriften eller strikkeren har laget

sin egen fargevariant. Det endte med at jeg ikke ble ferdig før jeg måtte gå

hjem, og jeg så for meg at jeg trengte å bruke et par timer på det i dag. Hadde

jeg blitt på jobb hadde jeg nok også lett brukt et par timer.

Når jeg kom på jobb i dag så jeg umiddelbart hva som var feil, et lite stykke

unna der jeg jobbet i går, og fikset alt på ca 5 minutter.På det tispunktet fantes ikke nettsiden. Poenget var ikke å lage nettside, poenget var å skrive sammen og dele hva v i har skrevet.

Lekser:

Tidlig produktverdi er ofte fullstendig frakoblet hva man har skrevet av kode. Målet med Mikrobloggeriet var å skrive sammen for å dele, lære og utforske, ikke lage webapp. Teknologien for å publisere tekst på nett er velprøvd, vi har hatt HTML i 30 år. Usikkerheten rundt om folk kom til å prøve å skrive én gang, og deretter om folk kom til å fortsette å skrive var betydelig større.

Hva som gir mening fra et produktperspektiv og hva som gir mening fra et utviklerperspektiv er her helt forskjellige ting, og begge deler må funke. Hvis du skal ta på deg både produkt og utviklerhatten, må du både definere et verdiforslag du kan ta ut i verden (“product discovery”) og faktisk ta verdiforslaget ut i verden (“product delivery”).

Ting som lever i verden og brukes av ekte folk er gjerne enda mer spennende å putle med enn stæsj man koder litt på på egen maskin! Når ekte folk bruker verktøyet du har laget, blir alt mer ekte.

Høy kohesjon

Holdningen min til arkitektur i Mikrobloggeriet var lenge at ett navnerom holder. Jeg vil dra fram ett blindspor, og en suksess. Vi starter med blindsporet.

Helt i starten splittet jeg opp Mikrobloggeriet-koden i to mapper: CLI-et for å skrive innlegg, og HTTP-serveren som skal vise Mikrobloggieriet på Internett. Det lagde flere problemer enn fordeler.

- Editorer som Emacs og VSCode gir mer hjelp når man redigerer én mappe med kode

- Når man har én mappe med kode har man ett sett med avhengigheter

- Når man har én mappe med kode, er å installere avhengighetene til den ene kodebasen noe man gjør én gang

- Når man har én mappe med kode, er bruken av koden frakoblet fra koden. Man står fritt til å organisere koden der man vil logisk i strukturen, uten å tenke på hvilket underprosjekt som har hvilken funksjonalitet.

Mikrobloggeriet er nå én mappe med én kodebase, og det har fungert mye bedre for meg. Kutt kompleksitet, og bli glad! 😊

I selve server-koden gjorde jeg et valg jeg i dag er mer fornøyd med:

putt server-ting i mikrobloggeriet.serve inntill ting har

et bedre sted å være. Serveren startet som en router og noen

HTTP-handlere. Routeren sier hvor en gitt HTTP-request skal, og

HTTP-handlere tar inn en HTTP-request og gir en HTTP-respons. Jeg tror

både Johan og Olav har bemerket at mikrobloggeriet.serve er

stor! Og det er jeg helt enig i. Store moduler som ikke er “ferdig

splittet” er litt vanskelige å sette seg inn i. Det går liksom ikke å

“skjønne hele greia” på ett forsøk, man må heller se på hvordan koden

brukes i enkelte konkrete tilfeller. Starte med å skjønne hva som skjer

på en GET /, gå videre derfra.

Lekser:

Ved å splitte opp for tidlig risikerer du å splitte opp på feil måte, som kan gjøre enda mer vondt enn å ha ting samlet en stund. Ekstremvarianten er tidlig, voldsom splitting i separate tjenester, som Olav advarer mot i OJ-4:

Dette gjør også appen, og eventuelt podden veldig mye mer sårbar til å krasje. Ta hensyn for dette, evnt ved å splitte ut egen logikk for orkestrering, og tenke på retry-mekanismer. Mikroservice-helvette lusker visst overalt. Mitt beste tips her er å sørge for god tilgang til informasjon om ressursbruk i kjøremiljøet.

Store moduler kan gjøre vondt når man ikke kjenner koden.

Lav kobling

Så, hva gjør man når modulen har blitt for stor? At modulen er for stor betyr gjerne at den gjør for mange ting. Hvis vi klarer å trekke noe til side, er det bra!

MEN.

Hvis det faktisk skal bli enklere, må det vi trekker til side være lavt koblet med resten av koden. Ellers blir det ikke enklere å jobbe med!

Her kan du vurdere om det funker ved å lese koden direkte.

- Leser koden i hovedmodulen bedre etter at du trakk til side et lite problem?

- Hvor mange ganger kaller du fra hovedmodulen til sidemodulen?

Hvis hovedmodulen faktisk leser bedre etter at du har splittet opp, og det ikke er alt for mange funksjonskall fra hovedmodulen til sidemodulen, har du lav kobling!

God jul :)

Håper julefreden senker seg hos deg også! Hilsen Teodor

☃❄🎄

Les, skriv, og lær! Det er lov å være nysgjerrig!

Ikke sant, jeg må huske å stille spørsmål til publikum!

Jeg oppfordrer til det sterkeste til å skrive på Mikrobloggeriet, både om ting du lærer (innlegg) og kode. For meg har det vært superviktig, gitt meg et lass av nyttige erfaringer, samt mye mer mot bak meningene mine om produkt og teknologi.

Hvis du synes dette innlegget var spennende, oppfordrer jeg til å skrive et eget innlegg! ITERATE-kohorten er for eksempel et fint sted å skrive hvis du jobber i Iterate.

OJ-4: Hodeløse nettlesere i produksjon

Det finnes noen grunner til at du ønsker å kjøre en headless nettleser i produksjon. Det kan eksempelvis være å ta skjermbilder av en nettside, generere PDFer, skraping, automasjon, eller ende-til-ende tester. Altså om det er noe du må inn i nettleseren for å verifisere eller fikse. Bibliotek som Playwright, Puppeteer, Selenium og Cypress gjør det høvlig enkelt å skrive kode som interagerer med nettleseren. Og rett slik kan du automatisere hva nå enn du ønsker å gjøre i nettleseren. De vanligste headless nettleserene er Chromiums, Firefox, og Webkit, altså som de vanligste ikke-headless nettleserene, bare headless.

For ordens skyld: en headless nettleser er da en nettleser uten et grafisk brukergrensesnitt, og da ganske egnet for å kjøre i bakgrunnen på din maskin, eller, som jeg skal komme tilbake til, på en server.

Vi jobber med kode som blir vevd inn blant annen kode fra flere andre team, til et og samme produkt. Derfor opplever vi støtt og stadig at endringer utenfor vår kode brekker funksjonalitet vi har ansvar for. Og akkurat derfor fikk vi idéen om å lagen tester som alltid gikk automatisk i bakgrunnen, og sjekket disse tingene for oss. Dette har også medført en del fallgruver, så jeg tenker å vie resten av dette skriveriet til.

1. Ikke kjør en nettleser i produksjon om du absolutt ikke må

Stort sett ønsker man å kjøre slike programmer lokalt eller kanskje tester i CI. Et vanlig bruksområde er ende-til-ende tester som trykker seg rundt i applikasjonen din, sjekker at ting er der de skal være, men også at resten av systemet som skal tjene front-enden fungerer. I de aller fleste tilfeller er dette mest relevant å teste ved endringer. Har du ikke behov utover dette, eller som du tenker det går fint å kjøre fra din maskin er min anbefaling at du holder kjøringene der.

Men så finnes det jo alltid en eller annen grunn til at du kanskje føler du må dette alikevel. Eller en slik grunn greide i alle fall vi å pøske frem for oss selv. Det har jo også gitt litt hodebry.

2. Nettlesere krever mye minne og CPU

Appen din bruker nødvendigvis ikke så mye ressurser, men det gjør en

nettleser. Det er jo tross alt et ganske stort program man trekker inn.

Derfor må man sørge for at man har gitt tilstrekkelig med ressurser. Og

det nettleseren får, er den ofte gira på å ta. For oss har dette

innebært mye OOMKilled og en del store CPU-spikes, eller

throttling om man har limits på slikt. Det krever rett og slett en del

skruing på knapper og måling av bruk for å lande på en ideel

ressursallokering og skalering. I min erfaring går det ofte fint med

litt CPU throttling for noen tester, men blir det for mye endte

vi i prakis opp med flaky tester fordi ting lastet for treigt.

Dette gjør også appen, og eventuelt podden veldig mye mer sårbar til å krasje. Ta hensyn for dette, evnt ved å splitte ut egen logikk for orkestrering, og tenke på retry-mekanismer. Mikroservice-helvette lusker visst overalt. Mitt beste tips her er å sørge for god tilgang til informasjon om ressursbruk i kjøremiljøet. For Kubernetes har jeg hatt veldig god nytte av k9s CLI og Grafana.

Og til slutt så er det jo noen som skal betale for skymorroa, og selv om man ikke alltid blir eksponert for sluttsummen selv.

3. Bruk grensesnittet ditt bibliotek gir til nettleseren riktig

Jeg tenker jo at dette skulle være åpenbart, helt til jeg skøyt meg

selv i foten ved å glemme browser.close(). Dette er altså

Playwright-funksjonen for å lukke en nettleser, og ved å ikke lukke den

mellom hver test endte jeg opp med svært mange nettlesere, og til slutt

svært mange OOMKilled og drepte podder. Skriv denne koden med omhu.

Her er det også veldig mange måter å optimalisere, som ikke nødvendigvis er helt intuitiv. Eksemplevis kan dette være parallelisering, eller lage en kø for å kjøre ting sekvensielt. Dette er avhengig av hva du skal, hvilket bibliotek du bruker, og hvor mye ressurser du har tilgjengelig. Her er det relevant dokumentasjon for ditt bibliotek som gjelder, men for resten har jeg ikke funnet noen tydlig informasjon om hva som er best. Vi kjører ting sekvensielt med en kø.

Her er det også verdt å nevne at nettlesere kan ta inn massevis av argumenter på oppstart, hvor det finnes noen som er ekstra relevant for å kjøre en headless nettleser i containerised miljøer (eksempelvis Docker). Disse varierer fra nettleser til nettleser, og slik jeg tolker det er det viktigere for headless Chromium og headless Firefox, og mindre viktig for headless Webkit. Mange av disse argumentene kommer med avveininger. Eksempelvis ved å skru av sikkerhetsmekanismer som sandboxing for bedre ytelse, eller redusere ytelsen på kost av poteniselt mer flaky tester.

Her er en god oversikt over argumenter til Chromium.

Jeg har ikke funnet en tilsvarende god oversikt for Firefox config dessverre.

4. Nettlesere lager prosesser som ikke nødvendigvis blir ryddet opp skikkelig

Jeg har også fått inntrykk av at nettlesere har en tendens til å starte egne prosesser som ikke nødvendigvis blir avsluttet når man avslutter nettleseren. Dette kalles noe så kult som zombie processes! Skrekk og gru!

Særlig i containeriserte miljøer er det viktig å huske å drepe disse

før de spiser opp PIDer (prossess-IDer for aktive prosesser) og minne.

For å drepe zombier anbefales det å bruke et init-system i

containeren, som dumb-init eller tini. Disse konfigureres da

som en parent-prosess til det du tenker å kjøre i containeren, også har

innebygd logikk for å rydde opp i nettopp zombie prosesser. I nyere

versjoner er forresten tini bygd inn Docker og Podman, men må

da startes på run med flagget --init. Hvordan

jeg konfigererer opp args for docker run i kubernetes har

jeg ikke blitt helt klok på, så jeg ruller med tini for nå.

Selv med dette virker det ikke alltid som nettleser-prosessser blir ryddet opp helt skikkelig, i alle fall mens nettleserne driver å kjører. Jeg har brukt programmer som htop til å aktivt monitorere prosessene som lever i min container for å prøve å få bedre bukt på dette. Om noen har noen tips akkurat her tar jeg gledelig i mot.

Avslutningsvis vil jeg gjerne gjenta at poeng 1. Prøv å unngå å prodsette disse beistene om du kan unngå det. Hodebryet er så mangt, og jeg er ikke i mål. Det finnes også selskaper som tilbyr headless nettlesere som en tjeneste. Det virker veldig digg, men jeg har ikke testet de. Jeg har derimot hentet en del tips og inspirasjon fra ett av de her.

Har du noen tips eller innspill?

-Olav

Lynraske modultester med én tastekombinasjon

Å oppleve lynraske modultester i bruk har endret på hvordan jeg liker å strukturere og jobbe med kode. Kanskje lynraske modultester er noe for deg også?

Hvordan skriver du koden din?

Lynraske modultester med én tastekombinasion er en fryd å jobbe med fordi det gir en super boost til feedbacken du får når du skriver kode. Kanskje noe å vurdere hvis du ikke har prøvd? Les videre for å høre hvorfor du bør ta lynraske modultester seriøst, og hvordan du får det til med Clojure, Javascript, Go og Python.

Hvorfor du bør ta lynraske modultester seriøst

Du kan kode raskere hvis du kan sjekke om koden funker raskere. Hvis du vet nøyaktig hva koden gjør, er du klar til å endre den.

Med lynraske modultester får du bekreftet at koden gjør hva du tror den gjør umiddelbart. Det lar deg endre og legge til funksjonalitet uten frykt. Når du også stoler på at testene er korrekte og dekker det du bryr deg om, kan du også sjøsette ny kode straks den er skrevet og testene er grønne.

Så, hva er god nok feedback fra koden din? Jeg vil beskrive feedback langs tre akser.

Forsinkelse. Hvor lenge må du vente? Ti millisekunder? Ti sekunder? Hvis du kan holde feedback-loopen din lynrask er det helt supert! Her bryr jeg meg om “opplevd lynraskt”. En 60 Hz-skjerm gir deg et nytt bilde hvert 16. millisekund. 16 millisekunder er lynraskt! 200 millisekunder er OK. 1 sekund er dårlig.

Bredde Hvor mye dekker feedbacken du får? Når testene er grønne, stoler du nok på testene til å gå rett i produksjon med koden? Når du lener deg på modultester i arbeidet du gjør, må du kunne stole på at modultestene dekker det du bryr deg om i modulen.

Ergonomi. Å scrolle gjennom tusenvis av linjer printet i et svart vindu med hvit tekst er dårlig for hodet ditt. Se for deg at du kjører en bil, men i stedet for å se veien foran deg, får du en tekstkonsoll med linjer skrevet ut av en kjøreassistent. Det er null sjanse for at jeg setter meg i passasjersetet i den bilen.

Lynraske modultester er bedre målt langs feedback-forsinkelse, feedback-bredde og feedback-ergonomi enn andre mekanismer for feedback fra kode jeg har prøvd før1.

Modultester med én tastaturkombo i Clojure

I Clojure kaller vi modulene våre for navnerom. Hvert navnerom bor i hver sin fil. Vi legger oppførselen til modulen i én fil, og modultestene i et annen fil.

Lag deg en tastaturkombo som gjør følgende:

- Lagre filen du har åpen.

- Re-evaluer filen du har åpen.

- Kjør modultestene, og gi deg selv et sammendrag. (Dette må fungere både når du har markøren din i filen med oppførselen til koden, og når du har markøren din i filen med testene)

Ferdig! Nå har du det!

Hvis du vil prøve Emacs-oppsettet vårt, har magnars/emacsd-reboot

denne tastaturkomboen bygget inn som C-c C-k. Andre

Emacs-oppsett kan prøve M-x cider-test-run-ns-tests, og for

Calva med VSCode kan man sjekke dokumentasjonen for Calva Test Runner. Calva /

VSCode har også en helt nydelig støtte for å kjøre flere

tastatursnarveier etter hverandre med den fine kommandoen

runCommands. Les mer fra Peter Strömberg (skaperen av

Calva) i VS

Code runCommands for multi-commands keyboard shortcuts.

Jeg anerkjenner at å skrive lynraske modultester kan være en utfordring. Det kan til og med hende at du må tenke på hvordan du kan få testene til å bli raske når du deler systemet ditt inn i moduler.

Modultester med én tastaturkombo i Go og Javascript

Go og Javascript er godt egnet for en kjapp test-loop fordi det er raskt å kjøre en fil. At det er kjapt å kjøre en ny fil kan være et godt alternativ til et kjøretidsmiljø der du kan laste ny kode.

Lag deg en tastaturkombo som gjør følgende:

- Lagre filen du har åpen.

- Kjør modultestene til filen du har åpen, og gi deg selv et sammendrag.

Når vi ikke bruker et dynamisk kjøretidsmiljø, slipper vi å tenke på hvilken nye kode som skal lastes inn.

Modultester med én tastaturkombo i Python

Python har fått sitt eget avsnitt, fordi etter min erfaring, kan Python-tolkeren ta litt tid når du importerer tunge biblioteker.

Python har imidlertid et dynamisk kjøretidsimiljø! Kanskje du er uenig, eller aldri har hørt om det før? I så fall, sjekk importlib!

Se! Standardbiblioteket kommer med en modul laget for å laste ny

kode! Hvis du fremdeles er på Python 2, kan du se etter reload

(som ikke krever import av noen moduler).

Så lager du deg en tastaturkombinasjon som gjør følgende:

- Lagrer filen du har åpen.

- Laster ny kode fra filen med

importlib. - Kjører testene for den nylig importerte modulen.

Gjør det!

Koding skal være gøy! Hvis du rigger deg til med solid oppsett for testing, kan du fokusere på hva du vil at koden din skal gjøre, i stedet for å bruke dagen på å pønske på hvorfor koden tryner.

Appendix A: moro med dynamisk lasting av ny kode i Python

I 2017 og 2018 jobbet jeg med styrkeanalyse av en bru som kanskje i framtiden kommer til å krysse Bjørnafjorden. Bjørnafjorden ligger omtrendt midt mellom Bergen og Haugesund. Verktøyet jeg brukte til modellering er Abaqus. Første versjon av Abaqus kom i 1978: da kunne man skrive 3D-modellen sin som tekst i en inputfil, og få resultater. Alt implementert i Fortran!

Dagens Abaqus har både GUI og innebygget Python-miljø. Det muliggjør mer fancy 3D-modellering enn man kunne før. Vi regnet på skipsstøt i Abaqus, og simulerte storm med 3DFloat. For å sørge for at ting stemte mellom modellene, hadde vi Excel-ark og JSON-filer utenfor som beskrev parameterne til modellen. Jeg skrev koden for å bygge opp Abaqus-modellen.

I de første iterasjonene av koden, restartet jeg Abaqus for å kjøre koden min på nytt. Det gikk jeg etter hvert lei av, det var mye venting for å se hva én endring av én linje kode førte til.

Så jeg droppet omstart av Abaqus, og sørget heller for at jeg kunne laste ny kode fra inni Abaqus uten å starte alt på nytt. Da gikk alt drastisk mye raskere enn før.

Jeg fikk mulighet til å open-source en bit av arbeidet med å laste ny Python-kode dynamisk, nå tilgjengelig på github.com/teodorlu/hotload.

Du kan ikke bruke Hotload til å gjøre akkurat hva jeg beskriver her for å få til lynraske modultester, fordi hotload er laget til å lytte på filer, og kjøre kode med effekter på nytt. Det var uansett en spennende opplevelse for meg å se at jeg fikk til å ta kontroll over eget utviklingsmiljø, og at å laste ny kode inn i en kjørende Python-prosess var helt gjennomførbart. Hotload er noe du kanskje kunne skrevet til deg selv, koden er én fil på 300 linjer.

Unntatt tabeller og grafer når man jobber med svære datasett, men da tenker jeg gjerne på det jeg gjør som utforskning og analyse av data mer enn skriving av kode.↩︎

Javascript og React 101

Bakgrunn

Jeg har overhørt flere (spesielt designere) si at de gjerne skulle lært seg litt Javascript og React. Det kan være for å bedre forstå mulighetsrommet, bedre kommunisere med utviklere, lage prototyper, endre enkle ting i koden selv, eller bare av nysgjerrighet.

Uavhengig av hva motivasjonen din er, så kan det virke litt overveldene å finne et sted å starte. Og hvor man skal starte vil jo avhenge helt av hvordan man liger å angripe ting, og hva man kan fra før. De fire viktigste tingene å ha en forståelse for i mine øyne når man lager interaktive nettsider er HTML, CSS, Javascripg og eventuelle rammeverk (f.eks. React).

Personlig mener jeg at rekkefølgen man burde introduseres til de ulike delene er

- HTML (HyperText Markup Language)

- CSS (Cascading Style Sheets)

- JS (JavaScript)

- Rammeverk

Denne artikkelen fokuserer kun på grunnleggende ting i punkt 3 og 4. Å kunne HTML og CSS er ikke et krav for å forstå denne artikkelen, men min oppfordring er likevel å lære seg det grunnleggende der før en begynner på JS og rammeverk.

Målet med denne artikkelen er ikke å være en komplett guide, men mer en kjapp gjennomgang av konsepter jeg mener er viktig å forstå, slik at en har noen knagger å henge ting på og eventuelt noen nye spørsmål en kan stille en utvikler eller Google.

Nyttige resurser

MDN

MDN (Mozilla Developer Network) har veldig god dokumentasjon av HTML, CSS og Javascript med eksempler.

Kommentarer

// Dette er en kommentar. Alt etter // på en linje blir en kommentar og ikke en del av koden.

/*

Dette er en annen måte å skrive kommentarer på.

Den egner seg godt hvis du vil ha mange linjer med kommentar siden den har en start og en slutt.

Brukes ofte hvis man har mye kode man vil midlertidig ta bort eller ignorere.

Eventuelt til å dokumentere koden hvis man har mye å si

*/Variabler og konstanter

/**

* var er kort for variabel og er verier som man kan endre på.

* "var" sier at nå lager du en ny variabel.

* myVar er navnet på variabelen.

* Og 1 er verdien den får

*/

var myVar = 1;

/**

* Etter variabelen er laget trenger du ikke skrive "var" lengre når du skal gjøre ting med den

*/

myVar = 2; // Etter du har laget

// const, eventuelt konstant på norsk, er en verdi som ikke skal endre seg. Så nå vil alltid myConst være tallet 2.

const myConst = 2;

myConst = 3; // <- Dette er ikke lov og vil krasje, siden det er en konstant og ikke en variabel. Datatyper

/**

* !! For enkelhetsskyld blir det her en sannhet med modifikasjoner. Om en ønsker en mer teknisk riktig forklaring

* av datatypene til Javascript kan de leses her: https://developer.mozilla.org/en-US/docs/Web/JavaScript/Data_structures !!

*

* De vanligste datatypene i Javascript er Number, String, Boolean, Array og Object

*/

const myNumber = 12;

// myNumber er av typen Number

const myString = "Hei";

// String (tekst) markeres start og slutt med enten ", ` eller '. Dvs de fleste fnutter kan brukes. Forskjellen på dem er tema for et annet kurs

const myBoolean = true;

// Bolske verdier kan enten være true eller false.

const myArray = [12, "Hei", true, myBoolean];

// arrays er enkelt og greit lister. De kan inneholde alle de andre datatypene. Firkantklammer markerer start og slutt, og komma sperarerer elementene i lista

const myObject = { navn: "Iterate", alder: 12, ansatte: ["Meg", "Deg", "Hen"] };

// Objekter kan også inneholde de andre datatypene, men i motsettning til en liste så er alle verdiene i objektet navngitte.

const myName = myObject.name;

// Måten man henter ut en verdi fra et objekt er med å skrive navnet på objektet, punktum, og så navnet på feltet man vil ha. Så her blir myName satt til "Iterate"

/**

* (Warning, litt teknisk info)

* Javascript er "løst typet". Det vil si at variablene og konstantene har strengt tatt en type,

* men man trenger ikke definere den når man lager den, og for variabler så kan den endre seg.

* Dette skiller seg fra feks Java og TypeScript hvor man må si hva slags type en variabel er når man lager den,

* og den kan aldri være noe annet.

*/

var year = 2020; // Her er year et tall

year = "tjuetjue"; // Mens nå ble det endret til å være en tekst (string)

// Detter er fult lov i Javascript, men ikke lov å gjøre i Java, Typescript etc. Å endre på typen til noe på denne måten kan ofte resultere i morsomme bugs, men gir også en frihet. Funksjoner

/**

* Funksjoner defineres som vist under

* function <- sier at dette er en funksjon

* myFunction <- navnet på funksjonen

* () <- det som er inni parantesene definerer hva funksjonen tar i mot når den kalles (vi kommer tilbake til dette)

* { } <- det som er inni krøllparantesene er selve funksjonen

*/

function myFunction() {

}

myFunction(); // etter funksjonen er laget kan den kalles med å skrive navnet etterfulgt av paranteser.

/**

* Men myFunction gjør jo ikke noe som helst. Så la oss se på hvordan man kan lage en funksjon som legger sammen to tall.

*/

function sum(price, tips) { // Denne funksjonen tar inn to verdier når den kjøres. price og tips

return price + tips; // så returnerer den tilbake summen av dem

}

const total = sum(1000, 100); // total blir her da 1100. Merk at siden sum forventer to verdier må vi ha to verdier mellom parantesene når sum kalles

/**

* Funksjoner kan også defineres som en konstant i steden for å bruke function sytaxen.

* Det gjøres med en såkalt "arrow function" (fordi den har en liten pil i syntaxen).

*

* Dette er en veldig vanlig måte å lage funksjoner på i React-verden

*/

const subtract = (price, deduction) => {

return price - deduction;

}

const reducedTotal = subtract(1000, 100); // Her blir da reduced total 900Conditions

// ----------------------------------------------------------------

// Conditions

/**

* Hvis man vil at noe kun skal skje i noen tilfeller kan man bruke if-statements

* Merk at Javascript er litt rar på sammenliginger. Så når man vil sammenligne to ting vil man ca alltid bruke === og ikke ==

* Spør en voksen eller google om du vil vite mer.

*/

if (a === b) {

// do something

} else if (b === c) {

// do something

} else {

// do something else

}

/**

* Ofte i React hvis man skal gjøre enten a eller b (og aldri ha c, d, e,...) så bruker man en litt kortere og mindre lesbar måte å skrive if-else

*/

const y = a === b ? "a er lik b" : "a er ikke lik b";

/**

* Det som skjer over er at man sier at man skal ha en const y,

* og dersom a er det samme som b, så skal y settes til "a er lik b"

* og hvis ikke skal den settes til "a er ikke lik b".

*

* Dette brukes mye i react. For eksempel hvis en venter på data kan man ha noe i duren:

* isDataDoneLoading ? showUI : showSpinner

* For å kun vise UIet hvis man er ferdig å laste

*/🎉 Tada 🎉

Nå kan du Javascript! Eller… i hvert fall nok til å lese en hel del av det!

Imports

For å gjøre kode fra andre filer eller rammeverk tilgjengelig i fila må de importeres.

/**

* Stort sett alle filer med React kode starter med Import React from "react".

* Her sier man essensielt at man skal gjøre React biblioteket tilgjengelig i fila.

*

* Når det bare står import x from "y"; så importerer man ALT som er i "y".

* En annen måte er å skrive import {a, c} from "z";, da henter man bare a og c, men ikke b fra z

*/

import React from "react";

// Her skjønner Javascript at dette er et rammeverk som skal importeres og vet hvor React ligger

import { sum } from "./helpers";

// Her henter vi ut funksjonen sum som vi lagde i stad fra en fil som ligger i samme mappe som denne fila og heter "helpers". "./" betyr "i denne mappa". En annen vanlig syntax å se er "../helpers" som betyr "helpers i mappa ett nivå opp fra denne"React

React er litt forenklet et rammeverk som oversetter JSX til HTML. JSX ligner veldig på HTML, men man har muligheten til å gjøre veldig mye mer dynamiske ting med det.

/**

* Her definerer vi opp en React komponent. En "React komponent" er stort sett bare en funksjon som returnerer JSX.

* JSX er syntaxen for å skrive (nesten)-HTML i Javascript.

*/

const MyReactComponent = () => {

const myName = "Test Testson"

const age = 25;

return (

<div>

<h1>Hello {myName}</h1>

{age > 20 ? <p>Velkommen!</p> : <p>!!! Ingen under 20 slipper inn</p>}

</div>

);

}

/**

* I JSX kan man bruke krøllparanteser til å skrive javascript inni layouten din. Dette er ikke mulig på samme måte i vanlig HTML.

* I eksempelet over bruker vi en if-else for å sjekke om variabelen age er større enn 20, og i så fall vise en velkomstmelling, hvis ikke viser vi en sint melding

*

* Vi putter også "Test Testson" inn i tittelen på sida gjennom en konst. Dette er typisk slik man viser navnet på den innloggede brukeren dynamisk.

*/OLORM-56: Dit og tilbake igjen—TDD, TCR fra en REPL og tilbake til TDD

Når er det lurt å skrive tester? Hvordan skriver man tester? Hvorfor skriver man tester?

Effektiv enhetstesting i praksis er lettest å lære fra noen som har jobbet effektivt med enhetstesting før. Jeg prøver meg alikevel på en en tekst. Mest historiefortelling, bittelitt enhetstesting i praksis. Spenn deg fast!

Som utviklere kan vi oppnå en vanvittig effektivitet ved å kontinuerlig vite om systemet vi jobber på er rødt eller grønt, holde oss på grønn, og bli i flytsonen mens vi skriver kode. Tre teknikker du kan bruke for å komme nærmere flyt når du koder er test-dreven utvikling (TDD), test && commit || revert (TCR) og REPL-dreven utvikling (RDD). Hva betyr disse egentlig? Og hva kan du bruke nå?

I dag får dere høre om min reise fra TDD til TCR og RDD, og tilbake igjen til TDD.

TDD for dimensjonering av armering i betong

Den første kodebasen jeg jobbet på etter endt utdanning regnet ut nødvendig mengde armering per løpemeter for betongdekker i Python. Da jeg tok over koden hadde koden null tester. Jeg ble overrasket over at utvikleren turte å implementere denne logikken uten tester. Hva om utvikleren regnet feil? Da kunne jo bygg bli dimensjonert feil?

Det første jeg gjorde i den kodebasen var å innføre tester.

Jeg gikk svært sakte fram, og sjekket hva koden gjorde i dag. Og jeg snakket med en eldre byggingeniør med cirka 40 års erfaring med dimensjonering av betongkonstruksjoner. Sammen bygde vi en forståelse for hva koden skulle gjøre.

Etter at vi hadde innført tester i koden, var det tryggere for meg å endre koden. Testene lot meg sove godt.

Folk legger mange ting i testdreven utvikling, kjent som TDD (fra Test-Driven Development på engelsk). Én av definisjonene er at når du koder, gjør du følgende:

- Skriv en ny test som vil bli grønn når du har implementert noe ny kode

- Skriv kode som gjør at testen blir grønn på enklest mulig vis

- Observer at testene er grønne, eventuelt gjør at testene blir grønne

- Rydd i koden så det er tydelig hva koden gjør (kjent som “refactoring” på engelsk).

Man må ikke nødvendigvis skrive test før implementasjon. Men hvis du har tester på koden din, har du bedre kontroll på hva koden gjør. Da er det lettere å rydde i koden, og utvide koden til å gjøre nye ting.

TCR med Elm

Elm er et vakkert, ryddig, lite programmeringsspråk for å lage webapper. Elm-guiden er den beste introduksjonsguiden til et programmeringsspråk som jeg noen sinne har lest. Jeg synes Elm var så bra at jeg lagde og gjennomførte et kurs i Elm-programmering for barn, og snakket om erfaringene på Oslo Elm Day 2019.

Da jeg startet i Iterate fikk jeg jobbe litt med Lars Barlindhaug på Woolit-kodebasen. Vi skrev Elm sammen, og prøvde TCR. Det passet bra, fordi Woolit er skrevet i Elm, Elm er godt egnet for TCR, og Lars var med på bootcampen der TCR ble funnet opp. Lars skriver om sin opplevelse med bootcampen på How to test && commit || revert.

TCR med Elm var en fryd. Typesystemet til Elm er svært kraftig, og når man programmerer Elm sånn Elm er ment til å bli programmert, er det tilnæmet umulig å innføre feil i Elm. En ting som ofte sies om Haskell (et annet programmeringsspråk) er “if it compiles, it runs”. Hvis det kompilerer, funker det. Min erfaring er at det stort sett stemmer for Haskell, og at det ~alltid stemmer for Elm. Elm har et mer konsistent typeystem enn Haskell som er lettere å sette seg inn i ved å ha færre features. Et eksempel er typeklasser, typeklasser er en løsning for polymorfisk dispatch i Haskell. Les wikipedia.org/wiki/Expression_problem for mer info. Philip Wadler nevnes tidlig i Wikipedia-artikkelen, han er en av personene bak Haskell. Elm har ikke typeklasser. Det gjør Elm-kode lettere å lese og lettere å sette seg inn i enn Haskell-kode.

Lars og jeg satte opp TCR til å kjøre “test” som typesjekk. Vi skrev kode, lagret, og gikk kun framover hvis testene var grønne. Det utfordret meg til å tenke i mindre inkrementer.

Litt senere fikk jeg den samme leksa inn med teskje av å jobbe med Oddmund Strømme. Jeg hadde for vane å endre all koden, og være på rød lenge. Det har jeg nå gått tungt bort fra. Nå foretrekker jeg å holde meg på grønn hele tiden, og gjøre refatoreringer som en strøm av kompatible endringer, før jeg til slutt bytter over på ny implementasjon.

Når man gjør dette på teamnivå, kalles det ofte “trunk-based development”.

Umiddelbar feedback for alle kodebaser med REPL

Jeg foretrekker å bruke programmeringsspråket Clojure når jeg kan velge programmeringsspråk. Det er fordi Clojure er et godt egnet programmeringsspråk for REPL-Driven Development. REPL-Driven Development blir også kalt Interaktiv programmering. Hvis du er nysgjerrig på Interaktiv Programmering, er presentasjonen Stop Writing Dead Programs av Jack Rusher en underholdene introduksjon.

Jeg sporer meg selv av. Interaktiv programmering er å programmere fra innsiden av programmet sitt. I stedet for å endre filer som plukkes opp når man rekompilerer eller restarter i en terminal eller med en file watcher, sitter man med en editor koblet til en REPL, der man kan endre oppførselen til egen kode uten å restarte systemet.

Men! Interaktiv Programmering krever trening og disiplin for å brukes effektivt. Du kan lett ende opp i en tilstand der filenes tilstand på disk ikke reflekterer tilstanden til programmet ditt i minne.

Det problemet hadde jeg aldri da jeg skrev Elm med TCR. Jeg visste alltid med 100 % sikkerhet hver gang jeg lagret at koden min passerte typesjekken. Tilsvarende kunne jeg hatt enhetstester, men det hadde jeg ikke, og det følte jeg ikke at jeg trengte. Hvorfor kan jeg ikke få til det samme fra en REPL?

TCR fra inni en REPL

Så, jeg prøvde meg på å løse problemet. Og jeg fikk til det jeg prøvde! Github-repoet teodorlu/clj-tcr beskriver nå hvordan du kan få til TCR i Clojure.

Trikset er:

- Lag en ny TCR-snarvei i editor som du bruker i stedet for “evaluér uttrykk” og “lagre fil”

- Snarveien gjør følgende:

- Lagre alle filer

- Synkroniser tilstand i filer til tilstanden til den kjørende prosessen i minnet

- Kjør testene

- Reverter hvis testene feiler, commit ellers.

- Hvis synkronsiering av tilstand fra filene til den kjørende prosessen feiler, reverterer vi da også.

Her er Clojure-kode som gjør nettopp dette:

(ns user

(:refer-clojure :exclude [test])

(:require

babashka.process

clj-reload.core

cognitect.test-runner))

(defn reload [] (clj-reload.core/reload))

(defn test []

(let [{:keys [fail error]} (cognitect.test-runner/test {})]

(assert (zero? (+ fail error)))))

(defn commit []

(babashka.process/shell "git add .")

(babashka.process/shell "git commit -m working"))

(defn revert []

(babashka.process/shell "git reset --hard HEAD"))

#_{:clj-kondo/ignore [:clojure-lsp/unused-public-var]}

(defn tcr

"TCR RELOADED: AN IN-PROCESS INTERACTIVE LOOP"

[]

(try

(test)

(commit)

(println "success")

(catch Exception _

(println "failure")

(revert)

(reload) ; In those cases where we revert, we choose to clean up our mess

; -- don't leave the user with a REPL out of sync with their files.

)))Som Oddmund tidligere har sagt om TCR, er dette ikke kode man trenger et bibliotek for å bruke. Tilpass arbeidsflyten til koden og de som skal jobbe med koden.

Så binder du en tastatursnarvei i editoren din til å:

- Lagre alle åpne filer

- Kjøre

user/tcr.

Sånn kan den funksjonen se ut i Emacs Lisp:

(defun teod-clj-tcr ()

(interactive)

(auto-revert-mode 1)

(projectile-save-project-buffers)

(cider-interactive-eval "(clj-reload.core/reload)")

(cider-interactive-eval "(user/tcr)"))Så velger du en tastatursnarvei du vil bruke. For å binde til Option+Enter på en Mac som kjører Doom Emacs, kan du gjøre følgende:

(map! :g "M-RET" #'teod-clj-tcr)TDD 2: Dommedag

Hvis du ønsker å bli en bedre utvikler enn du er i dag, bør du jobbe med folk du har noe å lære av. En av utviklerne jeg mener jeg har noe å lære noe av er Christian Johansen. Han er en dyktig programmerer som lager gode biblioteker, og har lang erfaring med test-dreven utvikling og parprogrammering.

På Babaska-meetup i Mai fikk jeg par/mob-programmere med Christian. Jeg kjørte (satt ved tastaturet) og han navigerte (sa hva jeg skulle gjøre). Og han navigerte ved å fortelle meg at jeg skulle skrive tester. Jeg fikk instruksjoner som “skriv en test som sjekker X” og “fiks koden så testen er grønn”.

Jeg innså at vi fikk mesteparten av verdien jeg har fått fra TCR tidligere med god, gammeldags TDD. Skriv koden så den kan testes. Skriv en test som viser oppførselen du ønsker. Kjør testene kjøre, resultatet bør bli rødt. Skriv kode. Kjør testene, resultatet blir helst grønt. Repeat.

Å jobbe med flinke folk er skummelt. De kan ting som du ikke kan. Du føler deg kanskje dømt for at du ikke er flink nok ennå!

Men personene du jobber med er helst ikke en robot sendt tilbake i tid for å ta livet av deg, men heller en trygg utvikler som både ser hva du kan gjøre bedre, og også ønsker å investere i at du kan bli flinkere! Det er ikke til hjelp at noen sier “du, Teodor, du gjør alt feil, og dette er helt håpløst”. I kontrast er det supernyttig når noen viser hvordan de tenker, og stiller spørsmålstegn til rare ting du gjør som du kanskje ikke trenger å gjøre.

TDD fra inni en REPL

Programeringen med Christian fikk meg til å tenke. Jeg ønsker meg følgende:

- En REPL så jeg kan evaluere uttrykk

- Enhetstester som dekker det jeg bryr meg om

- En måte å vite at koden jeg kjører er i synk med koden som kjører på disk

- En umiddelbar måte å kjøre enhetstestene.

Så jeg skrev meg kode for å gjøre nettopp det i min Emacs:

(defun teod-reload+test ()

(interactive)

(projectile-save-project-buffers)

(cider-interactive-eval "(do (require 'clj-reload.core) (clj-reload.core/reload))")

(kaocha-runner-run-all-tests))

(map! :g "M-RET" #'teod-reload+test)Du kan gjøre omtrent det samme med Visual Studio Code og Calva også:

{

"key": "ctrl+[Semicolon]",

"command": "runCommands",

"args": {

"commands": [

"workbench.action.files.saveFiles",

{

"command": "calva.runCustomREPLCommand",

"args": {

"snippet": "(do (require 'clj-reload.core) (clj-reload.core/reload))"

}

},

{

"command": "calva.runCustomREPLCommand",

"args": {

"snippet": "(flush) #_forces-a-print"

}

},

"calva.runAllTests"

]

}

}Ikke test for å teste, test for å gjøre din egen hverdag bedre.

Jeg skriver ikke tester for testene sin skyld. Jeg skriver tester for meg selv og for de andre utviklerne på teamet mitt. Jeg vil ha et godt utviklingsmiljø lokalt, så jeg kan fokusere på å kode, ikke å stirre på stack traces. Og jeg vil ha kontroll på at koden i produksjon gjør det jeg tror den gjør. Derfor skriver jeg tester.

Når jeg møter en kodebase der README sier hvordan jeg kan kjøre testene, og testene dekker det som er viktig i koden min, blir jeg glad!

Appendix A: les Tolkien!

There and Back Again er også tittelen på en bok som er bedre kjent som Hobbiten. Den liker jeg veldig godt!

—Teodor

OJ-3: Kjøre språkmodeller på egen maskin

De siste par dagene har Ole Jacob og jeg utforsket hvordan vi kan kjøre språkmodeller (LLM-er) lokalt på vår maskin. Det vil si, vi fikk et par dager til å leke med denne teknologien for å se om det kunne bidra til å løse et reelt problem i et prosjekt.

Motivasjonen for å kjøre språkmodellene lokalt bunner ut i:

- Unngå avklaringsrunder og usikkerheter rundt om det er ok å laste opp data til en-eller-annen LLM-leverandør på nett.

- Slippe å styre med å lage bruker eller skaffe API-nøkkel til en eller flere tilbydere av LLM-tjenester.

I min erfaring er disse begrensningene ofte grunnen til at vi legger språkmodel-eksperiment på is allerede før vi har prøvd.

Her kommer derfor en liten oppsummering av hva vi har gjort med lokale LLMer og hva vi tenker om de.

Sette opp og kjøre språkmodeller på egen maskin:

Slik satt vi opp vårt språkmodell på vår maskin:

Kjøre selve språkmodellen

Vi lastet ned Ollama, som er et verktøy for å kjøre LLMer lokalt på maskinen. Man kan tenke litt på Ollama som en runtime for språkmodeller, som kan kjøre og interagere med modellene. Den kommer med et API, som gjør det enkelt for andre programmer å koble seg på.

Ollama kan startes enten ved å laste ned det offisielle

Docker-imaget, eller bare kjøre en enkel

brew install ollama om man vil kjøre den rett på maskina.

Vi gjorde sistnevnte.

For å komme i gang lastet vi ned llama3-8b, som er Meta’s

open-source språkmodell. Med Ollama kan den lastes ned med en enkel

ollama run llama3

Med ollama serve starter Ollama-serveren, som man

eksempelvis kan kalle slik:

curl -X POST http://localhost:11434/api/generate -d '{

"model": "llama3",

"prompt":"Hva er fordelen med å kjøre språkmodeller lokalt?"

}'Denne spyr den tilbake en response fra din lokale llama3. Her finnes det også biblioteker for å enkelt jobbe med Ollama requester og responser i koden din.

Sette opp et UI for å interagere med språkmodellen

Det finnes også mange med UI-er man kan klone ned og kjøre lokalt for

å få grensesnitt til kjapt interagere med din lokale LLM. Vi valgte å

bruke Dify, som gjør

det enkelt å behandle filer og bygge workflows LLM-er. Denne kjørte vi

også opp lokalt, men her ved å klone ned repoet og kjøre en

docker compose etter å ha fulgt Dify’s

dokumentasjon. Den starter en del greier, bla. en server, en

front-end, en database og en reverse proxy. Her var det litt

konfigurering for å sette riktig port i proxyen, og konfigurere den til

å kalle endepunktet til Ollama.

Dify har også ganske najs funksjonalitet for å importere data og gjøre det mulig å la en LLM å søke i det. Til dette koblet vi på en annen lokal språkmodel for å håndtere embedding. Videre kunne vi bruke denne dataen, og en språkmodell for å snakke med vår lokale språkmodell. Sånn ser det ut i Dify:

Så er det bare å kjøre denne, og chatte med språkmodellen som du ville med en annen GPT.

Knowledge retrieval fra egen maskin

De fleste språkmodeller er trent på utdatert informasjon, og har videre ikke informasjon spesifikk for din bedrift ol. I vårt tilfelle hadde vi en del filer, som vi ønsket at språkmodellen vår skulle kjenne til innholdet i. Til dette bruker vi teknikker som embedding, hvor man kan sende en rekke ulike filer og formater gjennom en annen embedding modell (vi brukte nomic-embed-text). Denne modellen brukte vi til å omgjøre filer til vektorer som kan sendes og tolkes som kontekst av språkmodellen vår. Når vi lagde kontekts kunne vi bla. gjøre mye rart, som å kjøre den på en måte hvor embedding-modellen vår lagde spørsmål-svar kombinasjoner til seg selv. Dette kverna litt på maskina, men tok heller ikke allverdens med tid.

Embedding av tekst er et fundament for å lage det vi ønsket å lage, nemlig en språkmodell som hadde konteksten av våre spesifikke forretningsbehov. Dette er hva som i dag ofte blir omtalt som å Retrieval Agmented Generation (RAG). Ideelt sett kan man da bruke også RAG til å søke i egene greier.

Sidenote om språkmodeller og programmer for å jobbe med disse.

I denne LLM-sfæren virker det som det dukker opp nye modeller og verktøy for å jobbe med de hver dag som går. Det her derfor ikke så mye verdi å bruke for mye tid på hvordan vi har jobbet med disse spesifikke verktøyene på vår maskin. Hensikten er i større grad å vise at de finnes, og hvordan de henger sammen, slik at vi har et bedre grunnlag til å kjapt komme i gang med testing når vi ønser å “gjøre noe med AI”.

Open WebUI er et annet alternativ til UI som jeg synes virker spennende.

Hva ble egentlig resulatet?

Tja. Hittil er det nok ikke superimponerende greier vi har konfigurert opp. Mestparten av tiden gikk med til å finne ut hvor vi skulle starte, og få det til å kjøre ok på vår maskin. Deretter var det å konfigurere data og prompts til å sjekke om denne teknologien faktisk kan løse problemet vårt. Hittil er kanskje ikke resultatene helt der, men det har nok noe med datagrunnlaget, promptingen og den litt mer lettkjørt språkmodellen vi brukte. Her tenker jeg en to be continued… er hensiktsmessig.

Jeg så også nå i ettertid at embedding-modellene vi brukte,

nomic-embed-text stort sett er trent på engelsk tekst, som

kan ha bidratt til at den heller ikke leverte varene skikkelig.

Hva har vi lært?

Det viktigste er at det er ganske rett frem å sette opp en LLM på maskina. Med riktig UI-verktøy kan man også prototype workflowen man ønsker å bruke LLMen i. Vi tenker dette kan gi et godt utgangspunkt til å (1) tørre å eksperimentere med data du ikke føler deg helt komfortable med å sende til himmels, og (2) få oversikt over hvordan du vil koble opp data, LLM og prompts før du begynner å kode det.

Man trenger heller ikke sånn alvorlig mye datakraft for å kjøre de

litt enklere LLMene, så å deploye den til en server eller putte den på

noe shabby hardware kan fortsatt monne til en del oppgaver. Vår

favorittvideo denne uken er til inspirasjon, hvor en svenske har

fylt svak hardware til bremmen med en usensurert

llama3-modell, og gjor den litt usikker.

Se opp for en demo fra oss, og ikke nøl med å spør om du er gira på å teste sjæl.

OLORM-55: Bør du lære deg Vim?

Jeg har skrevet mange ikke-tekniske tekster i det siste. Nå vil jeg skrive en teknisk.

I dag vil jeg adressere om du bør lære deg Vim.

Men jeg vil snakke om Vim ved å ikke snakke om Vim.

| Spesialtilfelle | Generelt spørsmål |

|---|---|

| “Bør jeg lære meg Vim?” | “Bør jeg lære meg ting som ikke umiddelbart gir meg verdi?” |

Det er mange ting du kan lære deg

Kanskje du lurer på slaveri i Libya. Kanskje du vil spille gitar.

Mange kule ting tar tid å lære seg.

Å lære vanskelige ting endrer deg

Når noe går veldig fort å lære kan det bety at læringsopplegget er helt fantastisk og du har hatt en vanvittig læringsfart. Det kan også bety at du egentlig kunne tingen fra før av, og har du har lært en ny måte å uttrykke et konsept du allerede kan.

Det en type vanskelige ting som er vanskelige uten at du egentlig burde trenge å lære deg det. Hvis du sitter og må huske 29 steg for hvordan du prodsetter kode kan det ta lang tid å lære seg, uten at du har lært deg en nyttig, ny ferdighet. Kanskje kunne de 29 stegene vært automatisert bort?

Det finnes en annen type vanskelige ting som er vanskelige fordi de er ting du ikke har gjort før. Du prøver deg, tenker at dette høres interessant ut. Du kaster deg ut i det. Så skjønner du ingen verdens ting. Så føler du ingen mestring.

Da kan du velge én av to ting: du kan avfeie det du prøvde, og sette det som et ikke-mål å lære seg. Eller du kan jekke ned selvbildet. Innse at du har noe å lære. Prøve å nå et enklere mål i samme retning.

Denne typen vanskelige ting endrer deg i læringsprosessen. Du går inn som én person, og går ut som en annen person: en annen person som kan mer. Du føler ikke lenger at det er ukjent, skummelt og vanskelig—det som startet som ubegripelig er nå håndfast. Det har blitt en hammer du kan bruke til ting, uten at du tenker på hvordan du holder hammeren.

Mange vanskelige ting på én gang?

Jeg har noen ganger overvurdert min egen kapasitet til å lære. Jeg setter meg et ambisiøst mål. Så gjør jeg ikke det ferdig, og starter med flere andre ambisiøse mål samtidig! Så blir jeg irritert fordi jeg ikke får framgangen jeg ønsker, og ingen prosessene blir ferdig. De flyter rundt uten at jeg føler at jeg har kontroll på tingene.

Fra dette har jeg lært at simultankapasiteten min for vanskelige ting er én.

Jeg vil ha én vanskelig ting å jobbe med, og noen lette på siden. Da fungerer jeg bra. Hvis jeg har en god dag, jobber jeg på den vanskelige tingen. Hvis jeg har en dårlig dag, jobber jeg på den enkle tingen.

Hva lærer du for tiden?

Hvor står du nå? Hva skulle du ønske at du ble bedre på?

Det er lure spørsmål å stille seg selv! Det er også lure spørsmål å diskutere med en mentor. Når du har tenkt over hva du faktisk ønsker å lære, er det lettere å lære.

Oppfordring: ha én vanskelig ting du jobber med å lære deg

Så, velg deg en vanskelig ting du vil lære! Uttrykk for deg selv hvorfor du vil lære tingen. Si til deg selv hva du vil gjøre når du har har fått kontroll på tingen. Det motiverer!

Så kan du velge å dele målet med andre hvis du vil.

Så, bør du lære deg Vim?

Å lære seg Vim gir null verdi den første måneden. Og null verdi den andre måneden. Men etter hvert snur det, og du er mer effektiv med Vim enn med piltaster og mus.

Jeg estimerer at jeg navigerer og redigerer 10-50 % raskere med Vim-bindings i editoren min enn jeg gjør uten.

Så hvorfor la jeg inn innsatsen? Jeg så en person redigere kode mye raskere enn meg, og tenkte at “hmm, jeg har lyst til å lære det”. Så prøvde jeg av og på ganske lenge før ting satt i fingrene.

Jeg har fremdeles mye å lære om Vim, men nå er de tingene lettere å lære. Jeg er over kneika, og kan lære meg én og én liten ting.

I går lærte jeg meg for første gang find replace, ala

:%s/Vim/Programmering i Zig/g. Da satte jeg av en halvtime,

leste litt manual, og fikk brukt find replace.

Og ikke lær deg Vim fordi noen har sagt det. Velg én vanskelig ting du ønsker å lære. Kanskje noe en person du har sett allerede behersker, da vet du at det er mulig.

Leke, lære, lage har en gang i tiden vært mottoet til Iterate!

—Teodor

Krøll på tidslinja

Vi har et ganske vanlig oppsett der en applikasjon lagrer tidspunkt i en MariaDB, og jeg oppdaga en dag at noen så ut til å ligge i rar rekkefølge.

Kun på én spesiell dag, om høsten. Mellom klokka 2 og 3 på natta. Du kan kanskje gjette dagen? Det er selvfølgelig når vi skrur klokka en time tilbake, den siste dagen av sommertid.

Koden i applikasjonen ser omtrent slik ut:

var created time.Time

// ...

db.Exec("INSERT INTO t(created,id,info) VALUES(?,?,?)", created, id, info)Både applikasjonen og databasen kjører med tidssone satt til

Europe/Oslo. Tiden som skrives (created) er

typisk ganske nært eksekveringstiden, noen sekunder eller minutter før

Now().

Det som skjer er følgende:

0. Applikasjon og database kjører med gitt tidssone (Oslo)

1. Applikasjon oppretter en tilkobling til databasen

som har en tidssone på _sesjonen_ (Oslo)

,------------------------. +------+

INSERT(ts) ---> ( session time_zone:XXX ( ) ---> | DB |

'------------------------' +------+

2. Database-driveren 3. Verdien konverteres

i applikasjonen konverterer fra sesjonens tidssone

gitt tidspunkt til sesjonens til UTC og lagres

tidssone og enkoder og sender verdien (Og oversettes fra UTC

til sesjonens tidssone

ved utlesing)Sesjonens tidssone kan settes av klienten, og arver ellers verdien fra DB-serveren.

Jeg hopper til poenget: Problemet ligger i enkoding av verdien i

kombinasjon med sesjonens tidssone. Tidspunktet enkodes som

2023-10-29 02:30:00[.000000] av driveren.

Med tidssone Europe/Oslo er denne tiden som kjent tvetydig, fordi den

skjer to ganger; først for sommertid, så for vintertid. Enkodingen må

derfor inkludere hvilken av dem det er snakk om.

Så, er det bare driveren som er dårlig? Nei, dessverre er det i MariaDB p.t. ikke mulig å enkode tidssone-info verken som binær¹- eller tekst-verdi (i motsetning til MySQL).

Løsningen er å sette sesjonens time_zone og verdiene

som skrives til en fast tidssone uten sommertid, f.eks. UTC.

Merk at dette problemet ikke er spesielt for Norge. Selv om stadig færre land har sommertid, er det fortsatt ca 70 land som gjenstår, inkludert nesten hele Europa og Nord-Amerika.

Hva kunne vi gjort for å unngå bug’en? Lite gjennomtenkte muligheter:

- Prøve å tenke seg til mulige spesialtilfeller?

- Lese hele MariaDB- og driver-dokumentasjonen?

- ~Lese all kildekoden?~ (urealistisk)

- Teste med alle tidspunkt/permutasjoner?

- Kun bruke ukomplisert tech/features?

- Detekter (tenkte) problemer når/hvis de oppstår?

- QA med eksperter?

Send meg gjerne gode forslag.

—Richard Tingstad

Tillegg: testing av tid

Jeg fant et kult bibliotek jeg kunne bruke for å endre tiden; libfaketime, og lagde meg følgende Dockerfile for å gjenskape tidligere tilstander:

FROM mariadb:11.3

RUN apt-get update && apt-get install libfaketime

ENV TZ=Europe/Oslo \

MARIADB_DATABASE=d MARIADB_ROOT_PASSWORD=r \

MARIADB_PASSWORD=p MARIADB_USER=u

COPY <<EOF /docker-entrypoint-initdb.d/0.sql

CREATE TABLE t ( id INTEGER AUTO_INCREMENT PRIMARY KEY,

ts TIMESTAMP, dt DATETIME );

EOF

COPY <<"EOF" run.sh

[ -n "$START" ] || START=$(date -d '2023-10-29 02:30 CEST' +%s)

LD_PRELOAD=$(find /usr -name libfaketime.so.1) \

FAKETIME=-$(( $(date +%s) - $START )) \

"$@"

EOF

ENTRYPOINT ["sh", "run.sh"]

CMD ["docker-entrypoint.sh", "mariadbd"](¹ “The encoding of the COM_STMT_EXECUTE parameters are the same as the encoding of the binary resultsets.” —Binary protocol)

OLORM-53: Forstå brukeren ved å bli brukeren

Å lage produkter for seg selv er forskjellige fra å lage produkter for andre. Hvis du lager produkter for deg selv, kan du vurdere produktet ved å se om produktet løser problemer for deg. Hvis du lager produkter for andre, må du vite om produktet hjelper brukeren i brukerens kontekst.

Er disse tilnærmingene gjensidig eksklusive, med andre ord, må du velge én?

Jeg vil si nei.

Hvordan forstå brukeren ved å bli brukeren

Du kan løse for begge ved å følge to strategier samtidig:

- Sett deg mer og mer inn i hva brukeren er som du ikke er. For hver ting brukeren gjør som ikke gir mening for deg, spør deg selv hvorfor, og prøv å finne ut hvorfor.

- Lær deg litt og litt av hva brukeren kan.